推しアイデア

指パッチンの音をトリガーにしてカメラが起動し、ハンドジェスチャーを行うことでショートカットを実行できる直感的な操作ツールです。まるでサノスや魔法使いになったかのように、キーボードやマウスに触れずにPCを操る万能感・没入感を体験できます!

―

指パッチンの音をトリガーにしてカメラが起動し、ハンドジェスチャーを行うことでショートカットを実行できる直感的な操作ツールです。まるでサノスや魔法使いになったかのように、キーボードやマウスに触れずにPCを操る万能感・没入感を体験できます!

PC作業中、「手を動かすのが面倒、ここショートカットできたら楽なんだけどな」と感じることがありました。そこで、誰もが一度は憧れる「指パッチンで世界を操る」というアクションをシステムに落とし込みたいと考えました。

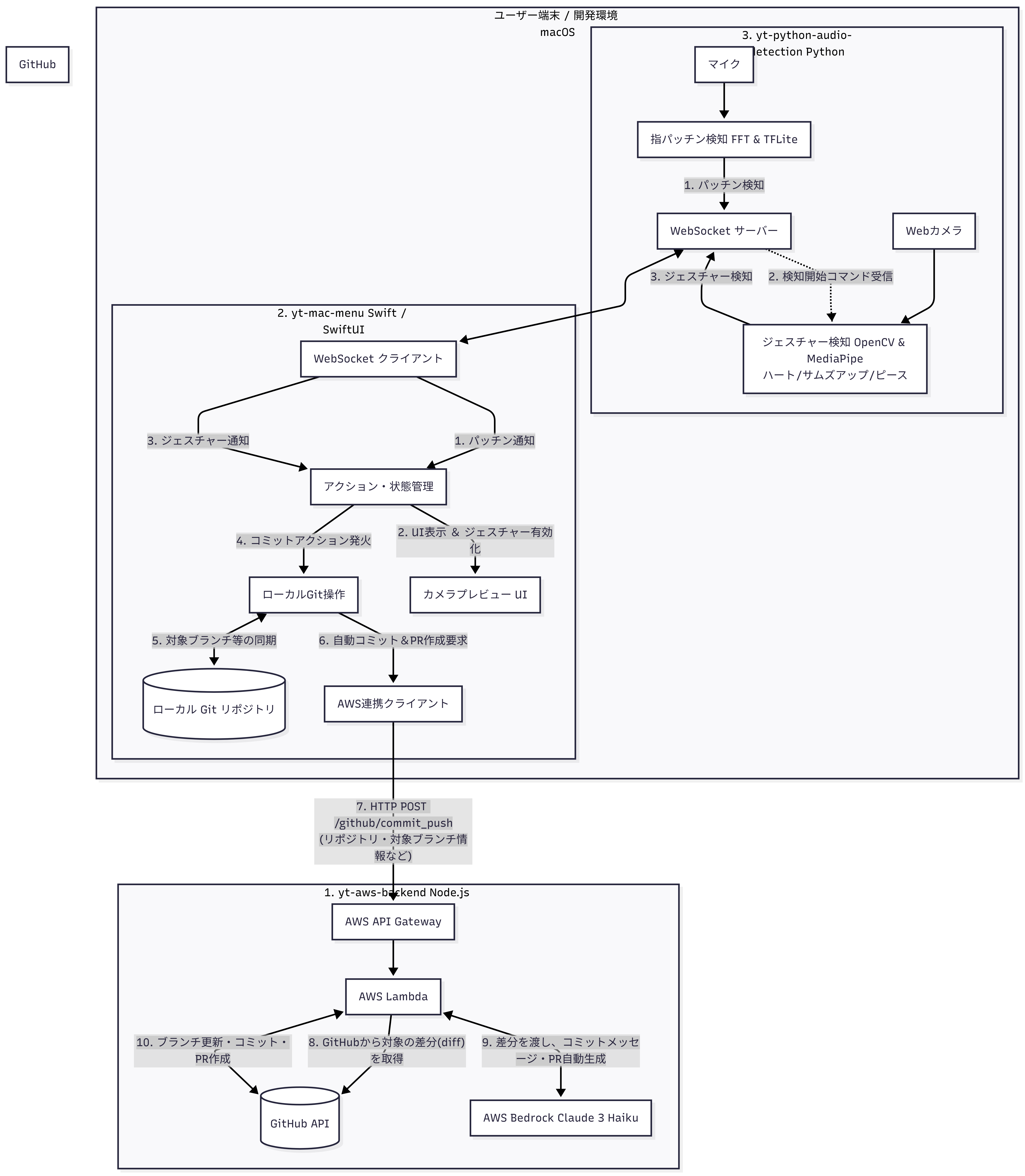

マイク入力のFFT解析による「指パッチンの高精度検知」と、MediaPipeを用いた「ハンドジェスチャー認識」のマルチモーダル連携です。音声検知をトリガーに動的に画像認識プロセスを立ち上げる省電力かつシームレスな設計が推しです!

『Thanos』は、「ある作業をするだけに手を動かすのが面倒」という日常の課題を、魔法のような体験で解決するシステムです。 音で目覚め、ジェスチャーで操る。圧倒的な万能感を味わいながら、日々の作業を効率化します。

最初のアイデア出しでは、コンシューマ向けのアイデアをたくさん挙げていましたが、ハッカソンということで、開発者向けの便利でおもしろいツールを開発するのが、いいのではないかとなりました。 そこから、一日の開発作業の終わりのコミットプッシュを気持ちよく爽快にできたらおもしろいよねということで、指パッチンをしたら、自動でコミットプッシュするアプリを開発することをキックオフ前に決めました。 しかし、キックオフで、画像+動画というテーマが発表されたため、新しいアプリのアイデアを考えなければならないことになるかと思いましたが、指パッチンだけでは、誤発動する可能性があったため、指パッチンでカメラを起動し、ジェスチャーによる特定のショートカット起動という機能に変更し、画像+動画というテーマに沿っただけでなくよりよいアプリへと改善しました。この改善により、様々なショートカットを行うことができるようになりました。 中間発表からのフィードバックを受け、エンジニアはキーボードを離すショートカットには合っていないのではないかということが挙がり、キーボードを触れる離すの最初と最後に区切りをつけるショートカットアプリにするのがいいのではないかということになった。

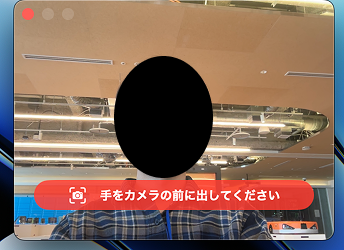

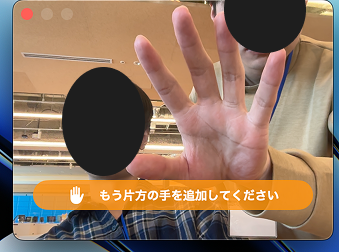

マイクが環境音をモニタリングし、指パッチン特有の高周波と立ち上がりを検知してカメラを起動します。

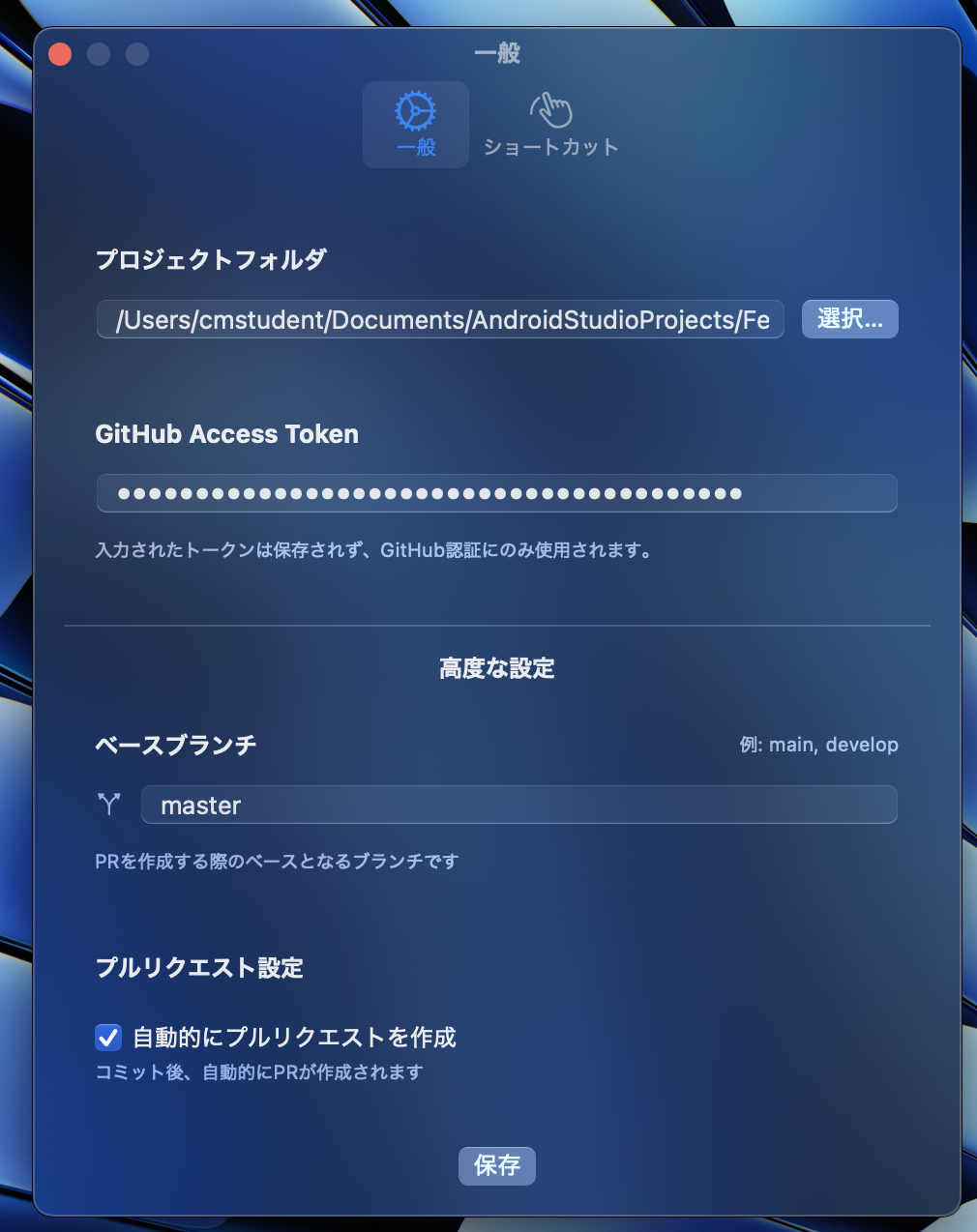

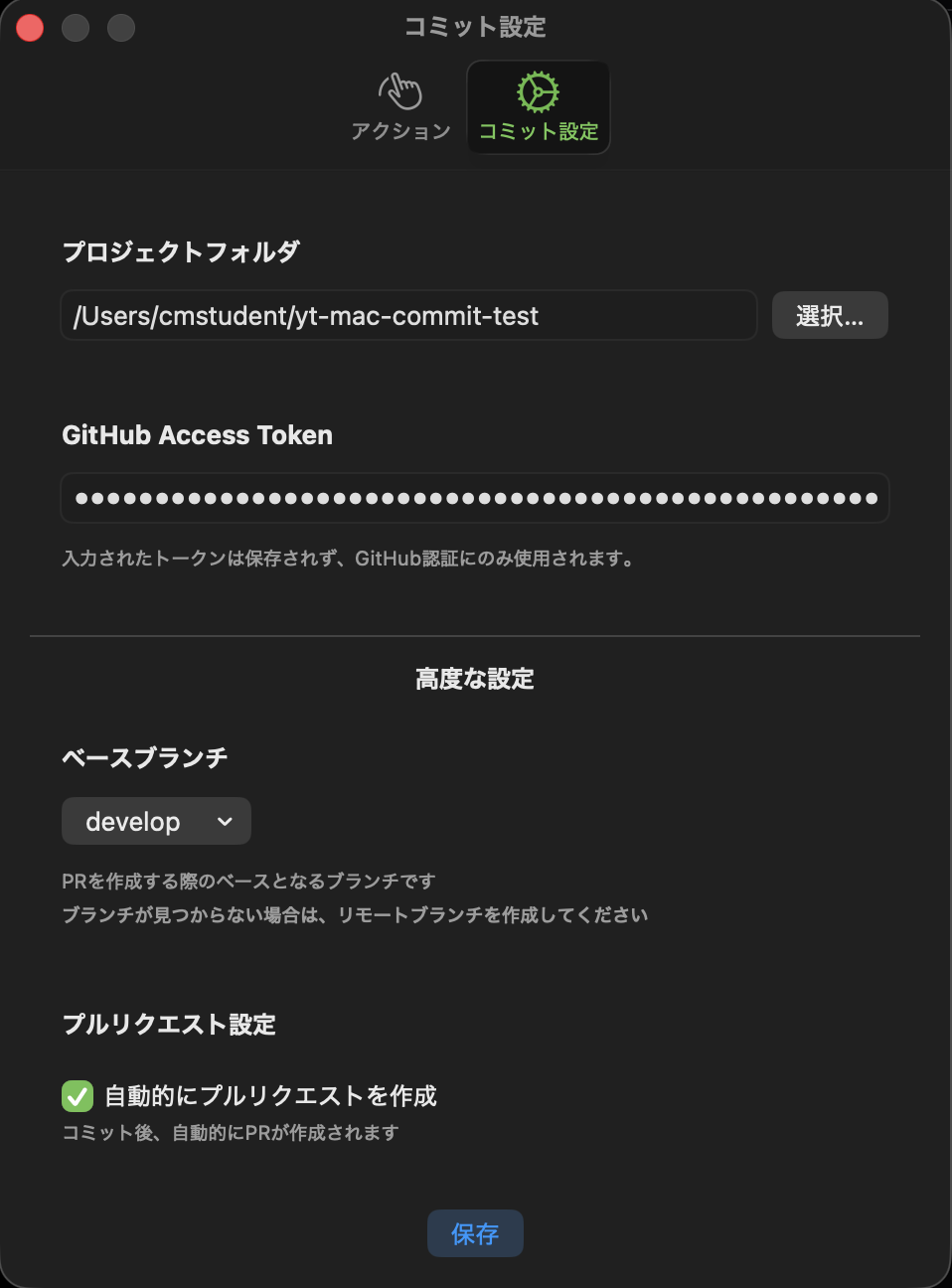

上の画面はGitオートコミット&プッシュのショートカット機能です。

上のテキストフィールドにプロジェクトフォルダのパスを

下のテキストフィールドにアクセストークンを入力することでベースブランチを自動で取得し、選択できるようにします。ショートカットを実行することでコミット&プッシュができます。更にAIで自動的にプルリクエストを作成することもできます。

上の画面はGitオートコミット&プッシュのショートカット機能です。

上のテキストフィールドにプロジェクトフォルダのパスを

下のテキストフィールドにアクセストークンを入力することでベースブランチを自動で取得し、選択できるようにします。ショートカットを実行することでコミット&プッシュができます。更にAIで自動的にプルリクエストを作成することもできます。

上の画面はターミナルコマンドの実行です。

コマンド:と書いてある横のテキストフィールドにターミナルコマンドを入力することでショートカットを実行した時にバックグラウンドでコマンドを複数実行できます。

上の画面はターミナルコマンドの実行です。

コマンド:と書いてある横のテキストフィールドにターミナルコマンドを入力することでショートカットを実行した時にバックグラウンドでコマンドを複数実行できます。

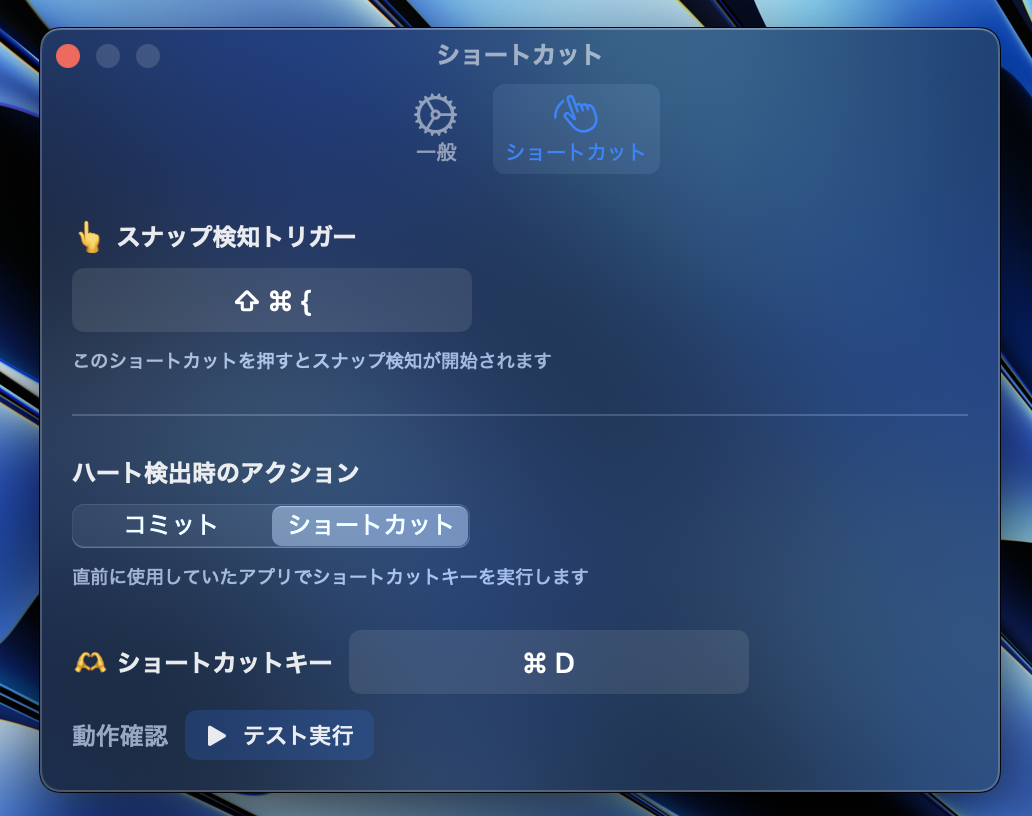

上の画面はショートカットコマンドです。

キーを入力することでユーザーの任意のショートカットキーを実行できます。

上の画面はショートカットコマンドです。

キーを入力することでユーザーの任意のショートカットキーを実行できます。

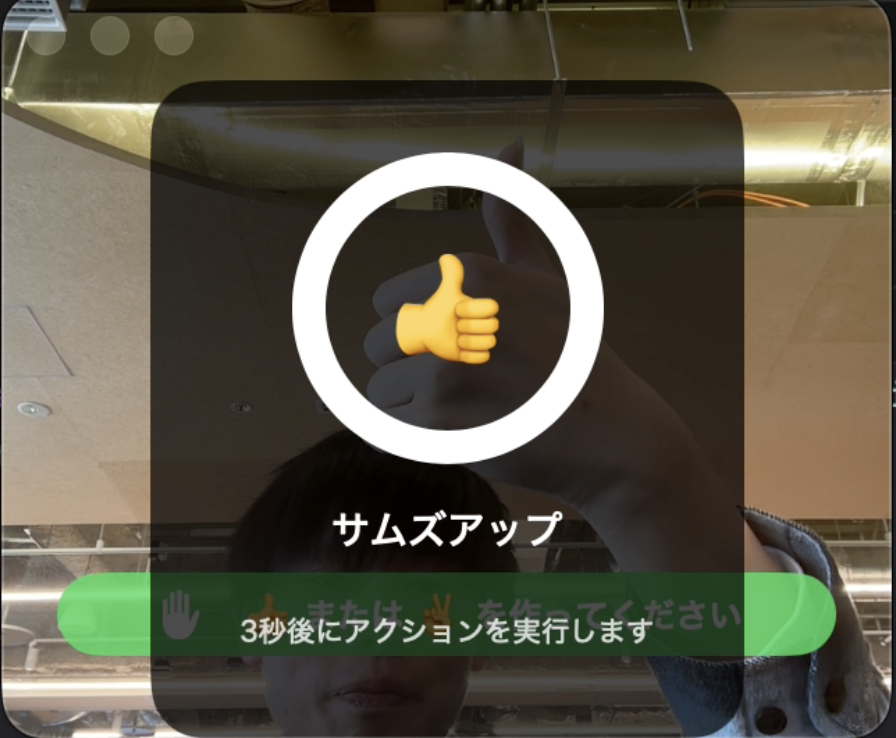

カメラ起動中に特定のハンドジェスチャー(ハート、親指を立てる等)を行うと、ショートカットを実行します。MediaPipeを用いた高精度な骨格推定により、スムーズな操作を実現しています。

特定のジェスチャーをトリガーにしてバックエンドのAWS環境を呼び出すことが可能です。例えば、Amazon Bedrock(生成AI)、GitHub APIを用いた自動コミット&プッシュなど、複雑なワークフローをワンアクションで実行します。

Edge & Sensing (ローカル)

Backend & Cloud (AWS)

API Integration